|

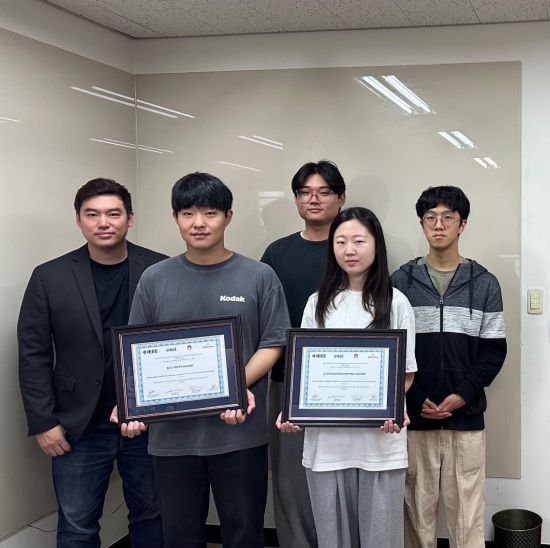

KAIST는 전산학부 박종세 교수 연구팀(조재홍·김민수·최현민·허구슬 학생)이 최근 캐나다 밴쿠버에서 열린 ‘2024 IEEE 국제 워크로드 특성화 심포지엄(IEEE International Symposium on Workload Characterization·이하 IISWC 2024)’에서 최우수 논문상과 최우수 연구 기록물 상’을 동시 수상했다고 11일 밝혔다.

IISWC는 컴퓨터 시스템 워크로드 특성화 분야 국제 학회다.

통상 최우수 논문상과 최우수 연구 기록물 상은 각각 수여돼 왔다.

하지만 올해는 박 교수팀의 논문이 두 상을 모두 휩쓸었다는 점에서 이례적이다.

앞서 연구팀은 ‘초거대 언어모델 추론 서비스 제공을 위한 하드웨어/소프트웨어 공동 시뮬레이션 인프라(LLMServingSim: A HW/SW Co-Simulation Infrastructure for LLM Inference Serving at Scale)’ 제하의 논문을 발표했다.

연구팀은 연구를 통해 챗GPT 등 거대언어모델(이하 LLM) 추론 서비스를 실행하는 대규모 시스템에 여러 하드웨어와 소프트웨어를 결합해 시뮬레이션할 수 있는 시뮬레이션 인프라를 제안했다.

이를 통해 그래픽처리장치(GPU), 신경망처리장치(NPU)와 지능형메모리반도체(PIM) 등 하드웨어와 반복 수준 스케쥴링, KV 캐시 페이징 등 초거대 언어모델 추론을 위한 소프트웨어 요소 모두를 시뮬레이션하는 것이 가능해졌다.

연구팀은 연구 성과가 향후 챗GPT 등 LLM을 활용하는 단순한 챗봇 인공지능을 넘어, 생성형 인공지능(Generative AI)으로 대표되는 미래 인공지능 산업에서 이종 인공지능 반도체 기반의 클라우드 시스템을 구축하는 데 활용될 수 있을 것으로 기대하고 있다.

IISWC는 연구팀이 LLM 추론 서비스를 위한 하드웨어와 소프트웨어를 통합한 시뮬레이션 인프라를 최초 개발한 점과 오픈소스로 공개한 코드의 완성도, 사용자 편의성 등을 높게 평가했다.

박 교수는 “연구팀은 앞으로도 생성형 인공지능을 위한 클라우드 시스템 연구를 지속해 나갈 것”이라고 말했다.

한편 이번 연구는 한국연구재단 우수 신진연구자지원사업, 정보통신기획평가원(IITP), 인공지능 반도체대학원 지원사업, 하이퍼엑셀의 지원을 받아 수행됐다.

대전=정일웅 기자 jiw3061@asiae.co.kr

<ⓒ투자가를 위한 경제콘텐츠 플랫폼, 아시아경제 무단전재 배포금지> |

등록안내

등록안내 등록안내

등록안내